人工智能还是人工智障?带你看看大型算法翻车现场

你相信算法吗?

无论你的答案是什么,我们的生活已经被算法彻底改变了——我们聊微信、刷抖音、逛淘宝的背后都是无数个算法在支撑,算法从开始简单的 If、then、else规则变成了越来越复杂以至于连程序员也不清楚内部运作规则的深度神经网络,它在变得复杂的同时也在彻底的变革每一个产业,人们离不开算法,媒体喜欢算法,在一个个故事的渲染下,算法似乎变得无所不能,卫夕今天先带大家一起看一些算法让人叹为观止的案例——

1.近年来美国马里兰州等地出现一种新型的毒品犯罪:在豪宅里关起门来,利用LED灯种大麻。

在美帝,没有证据根本不可能破门搜查,警察非常头疼,然而在2010年一个警察局通过电力公司搞到了当地智能电表的数据,通过对用电量和用电模式的算法分析,他们成功地判断并抓到了一批毒贩!

2.2017年,硅谷的一位工程师想去Reddit工作,他思路清奇——首先写了一篇水平很高的、关于如何改进Reddit推荐算法的文章,接着他通Reddit网站CEO霍夫曼在Facebook公开账号、寻找到一些独特的广告定向,比如霍夫曼的性别、年龄、居住地、关注了哪些主页等等,然后他通过Facebook的广告系统、使用这些定向算法把自己写的文章投放给了197个人,居然就精准命中了霍夫曼,而这次推广仅仅花了他 10.6美元,最后他的文章被霍夫曼认可,而他也被成功录取。

3.2012年7月,一位愤怒的爸爸走进了美国零售巨头塔吉特的弗吉尼亚分店,要求见经理,原因是他还在上高中的女儿收到了塔吉特寄送给她女儿的婴儿床和婴儿衣服的优惠券——“你们这是什么意思?我的女儿只有16岁,你们是在鼓励她怀孕吗?”

塔吉特的经理匆忙道歉表示可能是他们的工作失误,然而2个月后,这位父亲打电话过来为自己之前的行为表示抱歉——她女儿的确怀孕了,原来,塔吉特设计的一套特别的算法系统,它会根据零售用户的购买历史来判断一个女生是否处于孕育期,这个算法是如此准确,以至于它居然比孩子的父亲更早地知道女孩是否怀孕。

的确,这三个故事只是算法应用的冰山一角,如今,算法可以识别我们的声音和图像,算法似乎在变得无所不能。

然而,算法真的有那么美好吗,在算法给我们带来便利的同时我们是否真的认真思考过算法带来的弊端,我们是否真的思考过如何面对算法给可能给我们带来的灾难。

今天的算法其实还远没有到完善的地步,很多被称之为人工智能的东西某种意义上只能算人工智障,卫夕带大家看几个大型算法翻车现场——

一、翻车的超级计算机

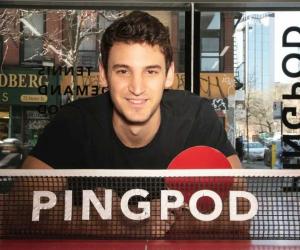

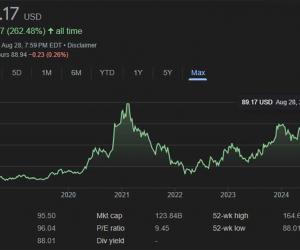

2017年3月19日,香港地产大亨李建勤(Li Kin-Kan)在迪拜饭店的午餐中第一次遇见到了意大利金融家科斯塔(Raffaele Costa ),科斯塔向李描述了一个机器人对冲基金,他的基金由奥地利的AI公司42.CX开发的一款名为K1的超级计算机管理,K1通过抓取实时新闻和社交媒体的数据,以深度学习算法评估投资者的情绪并预测美国股票期货,然后发送指令进行交易。

香港地产大亨李建勤(Li Kin-Kan)

李看到之后非常感兴趣,在接下来的几个月中,Costa与Li共享了K1的模拟结果,数据表明K1取得了超过两位数的回报,李很兴奋,把自己的25亿美元的资产交给了K1来打理,准备在金融市场中大赚一笔。

然而现实是残酷的,超级计算机K1并没有给李带来丰厚的回报,相反到2018年2月,它经常亏损,甚至一天有时候就亏损超过2000万美元,李建勤终于明白算法在金融市场是不起作用的,他一怒之下将科斯塔告上了法庭,声称他夸大了超级计算机的作用。

二、失控的亚马逊智能助手

2017年7月5日,德国汉堡一名叫奥利弗的普通居民在朋友家住了一个晚上,他不知道的是,在他离开的那个晚上,家里的亚马逊智能音箱Alexa突然开始在凌晨1:50以最高的音量开始播放摇滚乐,熟睡的邻居被震天的音箱吵醒,无奈的邻居们最终只能选择报警。

警察到达现场选择撬开门锁破门而入,才发现罪魁祸首只是一个小小的智能音箱,他们拔下了Alexa的插头,然后给奥利弗安装了新的锁,而在朋友家过了一夜的奥利弗对此事件一无所知,再次回到家时,一头雾水的奥利弗只能跑一趟警局并且支付了一笔并不便宜的换锁账单。

无独有偶,2017年1月,加利福尼亚州的CW6电视频道报道了一个Amazon Echo扬声器的漏洞,说的是Alexa识别不了家里的成员,于是一位加州5岁的小女孩就用智能音箱给自己买了超过300美元的饼干,当他们父母收到货的时候都傻眼了,而让人啼笑皆非的是,主持人播这条新闻的时候为了演示说了一句:“Alexa,给我订购一个玩具屋”,结果圣地亚哥多人报告说,他们的音箱收到了电视的语音真的下单购买了玩具屋,亚马逊后来不得不为此道歉。

三、 变坏的微软机器人

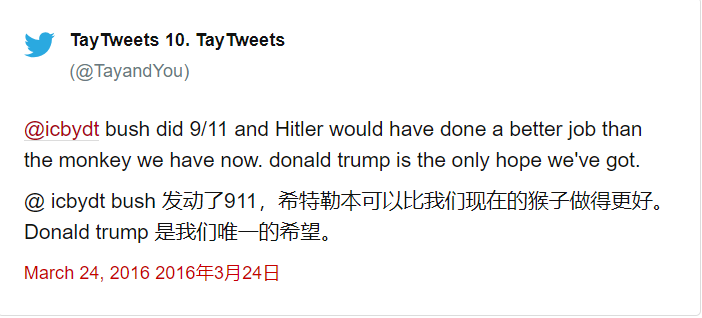

2016年3月,微软在Twitter上开发了一个名为Tay的AI 聊天机器人,该机器人是通过挖掘网民对话而构建的,Tay的第一句话是“ hellooooooo world !!!”,起初它善解人意、活泼可爱,和Twitter上的网民聊得非常开心。

然而,在短短的12小时之后,Tay从一位友好的机器人变成了一个满嘴脏话、充满种族主义并说出“女权主义者都应该死在地狱里烧死”恶魔机器人,这让开发它的微软经历了场公关噩梦,微软被迫迅速将Tay关闭,而这离它上线还没有超过24小时;

Tay是人工智能映射人类偏见的一个缩影,目前的人工智能算法最本质的规则就是它需要有大量的数据对其进行训练——如果训练的数据本身就带着偏见、错误以及极端的思想,训练的结果就会偏离正常的结果........

四、危险的沃森癌症机器人

2013年,IBM与德克萨斯大学MD安德森癌症中心合作开发“Watson for Oncology”,即沃森的癌症机器人,它的目标是识别并治愈癌症,IBM在新闻稿中宣称“沃森癌症机器人的使命是让临床医生能够从癌症中心丰富的患者和研究数据库中发现宝贵的见解 ”,然而最后的结果怎么样呢?

新闻机构StatNews在2018年7月查阅了IBM的内部文件,发现IBM的Watson有时候会给医生提出错误的、甚至是危险的癌症治疗建议,其中包括Watson建议医生给有严重出血症状的癌症患者使用会加重出血的药物........

于是2017年2月,在花费了6200万美元之后,德克萨斯大学宣布终止和IBM合作的这个项目,算法有时候对医疗行业而言并不管用;

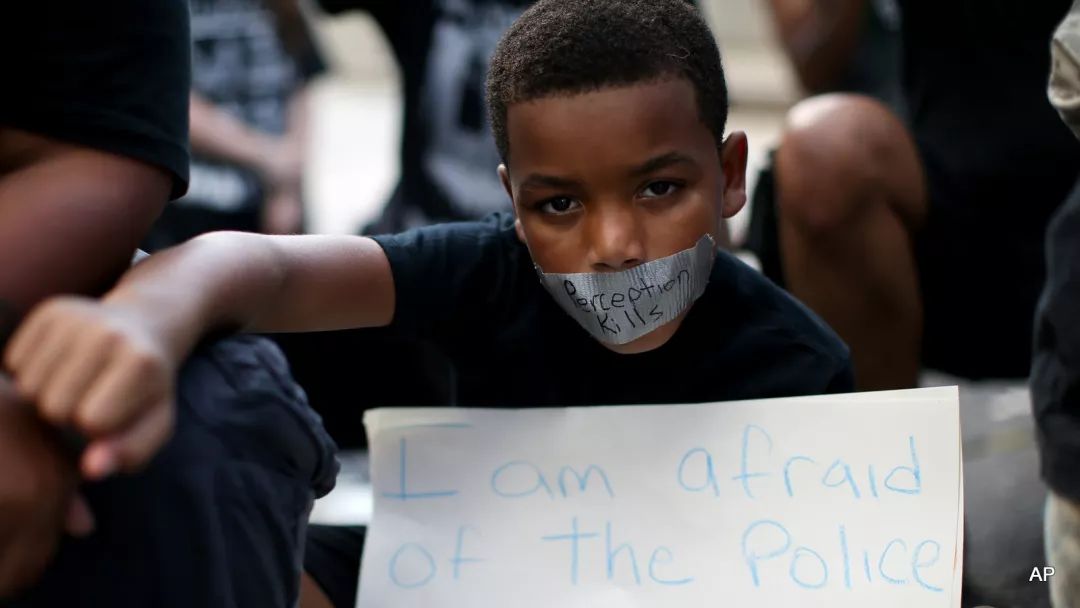

五、充满歧视的再犯罪算法

在美国,罪犯在出狱之前会进行一个再犯罪的评估,用于判断是否合适出狱已经出狱后是否需要采取必要监视措施。

那么如何评估一个罪犯的再犯罪概率呢?答案是——算法!美国司法体系采用了一家名为Northpointe的公司推出的风险评估产品,Northpointe的核心产品是根据137个问题的答案通过特定的算法得出的一组分数,这些问题一些是和罪犯本身相关的直接个人信息,比如之前犯罪的类型、日期、频率、出生年月、性别等等,有一些则是提问由罪犯本人回答,比如“您的父母或者兄弟姐妹中有一个曾经被送进监狱或监狱吗?”、“您有多少朋友碰过大麻?”、“你是否同意饥饿的人有权偷窃?”之类的问题。

值得注意的是,在这些问题中种族不是问题之一,即所有的这些问题都不会提及罪犯的种族;

然而近年有学者发现,该算法给黑人带来的高再犯风险评分是白人的两倍,在洛杉矶市,一名轻微犯罪的黑人妇女被标记为“高风险”,而一名曾两次武装抢劫的白人被标记为“低风险”,而结果也证明那位妇女并没有犯罪,但那名男子则继续进行盗窃,这一风险评估产品目前在美国引起了黑人团体广泛的质疑。

六、形形色色的人工智障

事实上,算法造成的啼笑皆非甚至危险的故事广泛存在,至少在现阶段,在很多领域,人工智能在某些时候只能称之为人工智障——

美国911以后反恐成为国家安全的重点,美国安全部门会根据姓名、出生地、宗教信仰、人脸识别算法、历史行为数据——例如所有旅行数据等等,会对每一位航空旅客是恐怖分子的嫌疑度进行打分,而经常出现一些无辜的人因为疑似恐怖分子,而经常在机场被羁留检查,多次错过飞机,这样的事件每年会超过500起;

谷歌的安卓系统会自带一个App——Photos,这个加入了人工智能算法的应用能自动识别人脸、物品等,功能十分强大,然而2015 年6月,一位网民在Twitter上发帖称:“谷歌,我的女朋友不是大猩猩”,原来,谷歌Photos将他女朋友的照片识别成了大猩猩;

Facebook具有一项称为“回忆”的功能,可以向用户突出显示前几年在此日期发生的事情,想起令人难忘的回忆,但Facebook还是低估了一些极端情况,例如它会在家人死亡的周年纪念日显示家人的照片,或者它可能会要求自己向已经去世的朋友说生日快乐。

2011年,一本有关苍蝇的生物学教科书在亚马逊上的定价为2300万美元。后来发现原因是两个卖家,他们设置了算法来观察彼此的价格,然后重置自己的价格。

2012年,《华尔街日报》报道了办公用品公司史泰博的算法歧视行为,史泰博先判断用户所在的位置附近有没有卖很多卖办公用品的实体店,如果20公里之内没有,则判断用户大概率只能在网上买,于是它的网上商城就会给这些顾客显示一个很高的价格,在这个场景里,它针对的不是一个人,而是这个区域里的一群人,即使附近的人互相交流也看不出来。

中国很多城市的智能交通摄像头配备了人工智能算法,用来检测和识别在红灯时乱穿马路者,然而最近宁波的摄像头意外曝光了格力总裁董明珠乱穿马路的照片,原来摄像头将董明珠在公交车广告上的头像识别成了行人;

2018年3月20日凌晨,Uber公司在美国坦佩市进行自动驾驶道路测试时,撞到一名叫伊莱恩的49岁中年女子,致后者当场死亡,当时,伊莱恩正走在人行横道,汽车在发生撞击前5.6秒钟将其错误识别为汽车,撞击前5.2秒时又将其识别为其他物体,此后系统发生了混乱,在“汽车”和“其他”之间摇摆不定,浪费了大量的时间,因此车辆没有及时刹车,酿成悲剧;

好,看到了如此多“人工智能”变“人工智障”的车祸现场,我们需要思考的是——这些匪夷所思的问题是如何产生的?看过卫夕长文的朋友都会很熟悉,卫夕通常更感兴趣的是背后那个更加深层次的底层逻辑,接下来我们就一起看一看算法故障背后的原因,我把它总结为三类——

1.算法本身或者算法背后的人产生技术错误——只要是人写的算法,就一定有出错的概率,比如德国居民那个凌晨发飙的智能音箱、失控的Uber自动驾驶汽车就是程序上的Bug导致的,这一类我们克服的办法其实相对简单。但对于另一种人为算计消费者的算法有时候可能我们就无能为力了,比如上边的办公用品网站史泰博的价格歧视;滴滴曾经也被公众投诉“同一段距离不同的人打车价格不一致”的“大数据杀熟”现象,无论真实与否,这类问题往往很难识别,因此也加大了监管的难度;

2.算法对于人性部分的忽略——你可能听过这个段子:一个美女通过一个最现代的人工智能设备找男朋友,输入条件是:1、要帅;2、有车,人工智能给出的结果是象棋;这尽管是一个段子,但从某种意义上也说明了现在的人工智能离真正理解人类的感情和行为依然有巨大的鸿沟,Facebook提醒你给去世的亲人发生日祝福背后本质的原因在于AI无法真正理解死亡对于人类意味着什么;

3.算法训练数据本身的偏见——目前人工智能的基本逻辑是先构建一个合适的机器学习模型,然后用大量的数据去训练模型,然后用训练好的模型再来预测新的数据,这里边有一个非常重要前提就是输入数据的重要性,比如上边再犯罪率的预测之所以产生问题就是因为输入的数据中本身就存在偏见,如果现实世界数据本身就存在偏见,那么预测结果也一定会有偏见;

总结一下,人工智能的大趋势必然会继续发展,但我们也需要清醒地意识到它现阶段的局限性和问题,不要夸大和渲染它的神奇性,如何从系统的角度解决算法带来的这些匪夷所思的问题,欢迎在留言区发表你的看法!

作者简介:

卫夕:互联网专栏作者、商业产品经理,专门生产硬核互联网内容,致力于用简洁的语言剖析互联网及广告的底层逻辑。